Ekspresowy start, zero komplikacji

Największe zalety ServBay to instalacja LLM jednym kliknięciem, lokalna praca, prywatność danych, tryb offline i niskie koszty. Wersja lokalna nie wymaga połączenia z siecią — dane są tylko u Ciebie.

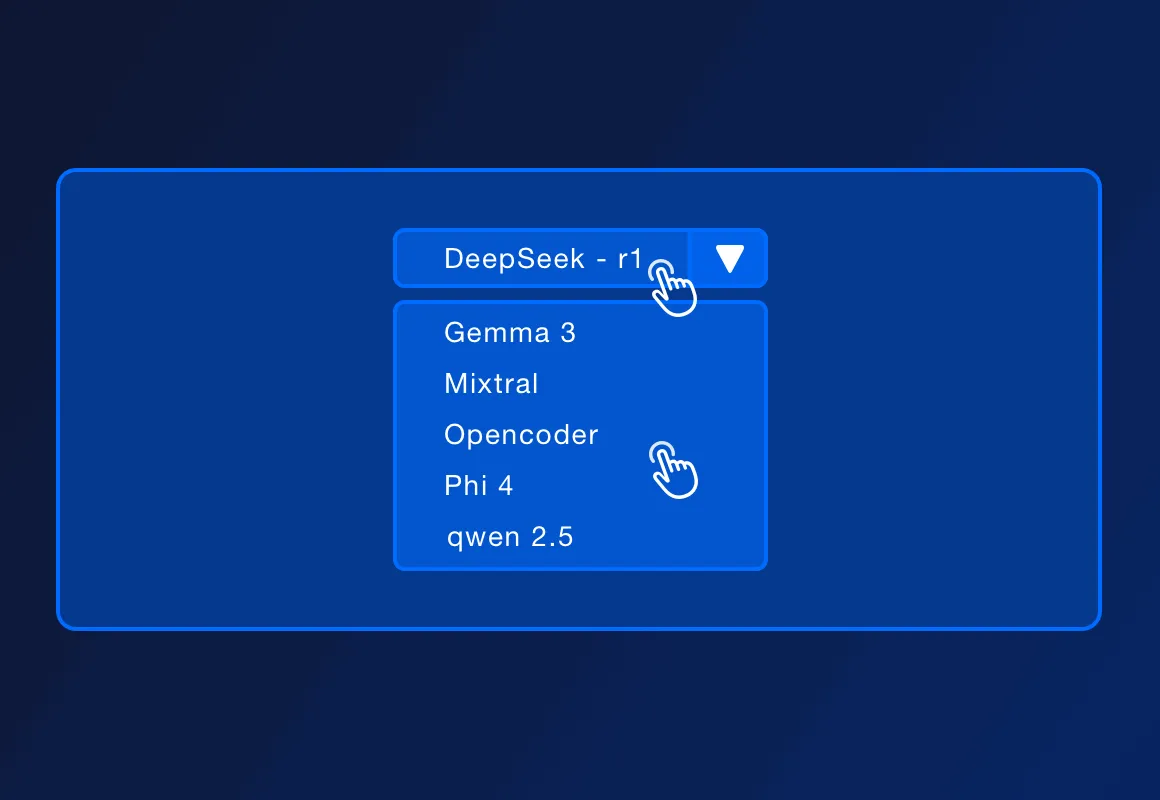

ServBay obsługuje popularne LLMy open source: DeepSeek - r1, Llama 3.3, Mistral, Code Llama i inne. Lista może się powiększać przy nowych wersjach.

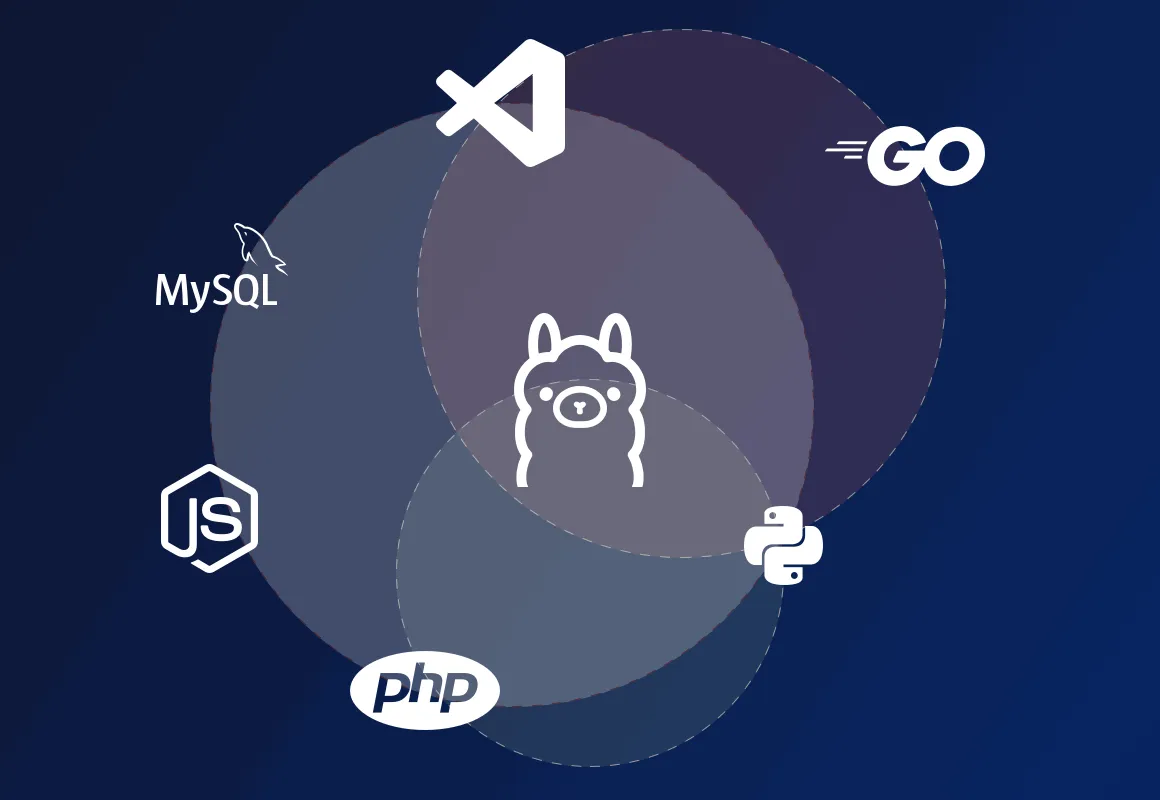

Tak, ServBay integruje PHP, Python, Node.js, Go i Ollama — idealnie do lokalnego developmentu, prototypowania i testowania. W przypadku produkcyjnych środowisk o dużej dostępności — możliwe są dedykowane wdrożenia.

ServBay to platforma managementu środowisk developerskich z gotowym PHP, Pythonem, Node.js, Go... oraz bazami i serwerami. Jednym kliknięciem instalujesz Ollama i korzystasz z modelu via REST API, tworzysz/przetestujesz lokalne aplikacje AI sterowane modelem.